相关分析和回归分析的区别与联系(不知道要不要)联系:都是研究非确定性变量间的统计依赖关系,并能度量线性依赖程度的大小。区别:从研究目的上看:相关分析是研究变量间相互联系的方向和程度;回归分析是寻求变量间联系的具体数学形式,是要根据自变量的固定值去估计和预测[1][1]因变量的值。从对变量的处理来看:相关分析中的变量均为随机变量,不考虑两者的因果关系;回归分析是在变量因果关系的基础上研究自变量对因变量的具体影响,必须明确划分自变量和因变量,回归分析中通常假定自变量为非随机变量,因变量为随机变量。P26-27:随机干扰项:观察值Y围绕它的期望值[2][2]的离差,是一个不可观测的随机变量,又称为随机干扰项或随机误差[3][3]项。引入随机干扰项的原因1)代表未知的影响因素;2)代表残缺数据;3)代表众多细小影响因素;4)代表数据观测误差;5)代表模型设定[4][4]误差;6)变量的内在随机性。P26、28:样本回归函数和总体回归函数的公式总体回归函数:在给定解释变量[5][5]X条件下被解释变量Y的期望轨迹称为总体回归线,或更一般地称为总体回归曲线。相应的函数称为(双变量)总体回归函数(PRF)。确定形式:随机形式:样本回归函数SRF画一条直线以尽好地拟合该散点图,由于样本取自总体,可以该直线近似地代表总体回归线。该直线称为样本回归线(sample regression lines)。样本回归线的函数形式[6][6]称为样本回归函数.确定形式:随机形式:P29:图2.1.3回归分析的主要目的:根据样本回归函数SRF,估计总体回归函数PRF。这就要求设计一方法构造SRF使其尽可能接近PRF。这里的PRF可能永远无法知道。P30-32:一元线性回归模型的基本假设假设1、回归模型是正确的。(选择了正确的变量;选择了正确的函数形式。)假设2、解释变量X是确定性变量,不是随机变量,在重复抽样中取固定值。_(i)=(overline {Y)}_(i)+(hat {mu )}_(i)=(hat {sigma )}_(0)+hat ({beta )_(1)}(X)_(i)+(e)_(i)假设3、解释变量X在所抽取的样本中具有变异性,而且随着样本容量的无限增加,解释变量X的方差趋于一个非零的有限常数。假设4、随机误差项具有给定X条件下的零均值、同方差和不序列相关性:E(i)=0Var (i)=2Cov(i,j)=0i≠j i,j= 1,2, …,n假设5、随机误差项与解释变量X之间不相关:Cov(Xi,i)=0 i=1,2, …,n_(i)=(overline {Y)}_(i)+(hat {mu )}_(i)=(hat {sigma )}_(0)+hat ({beta )_(1)}(X)_(i)+(e)_(i)假设6、随机误差项服从零均值、同方差、零协方差的正态分布注意:如果假设1、2满足,则假设3也满足;如果假设4满足,则假设2也满足。i~N(0,2) i=1,2, …,nP33:最小二乘法的推导过程(推导至2.3.5)普通最小二乘法(OLS)给出的判断标准是:二者之差的平方和_(i)=(overline {Y)}_(i)+(hat {mu )}_(i)=(hat {sigma )}_(0)+hat ({beta )_(1)}(X)_(i)+(e)_(i)最小。P38-40:最小二乘估计法的性质(重点看前三个,知道线性性和无偏性的推导)(1)线性性,即它是否是另一随机变量的线性函数;(2)无偏性,即它的均值或期望值是否等于总体的真实值;(3)有效性,即它是否在所有线性无偏估计量中具有最小方差。P44:图2.4.2区别那三个平方和(TSS,ESS,RSS)TSS=ESS+RSSY的观测值围绕其均值的总离差(total variation)可分解为两部分:一部分来自回归线(ESS),另一部分则来自随机势力(RSS)。总体平方和回归平方和残差平方和P45:可决系数R2统计量拟合优度检验:对样本回归直线与样本观测值之间拟合程度的检验。度量拟合优度的指标:判定系数(可决系数)R2_(i)=(overline {Y)}_(i)+(hat {mu )}_(i)=(hat {sigma )}_(0)+hat ({beta )_(1)}(X)_(i)+(e)_(i)可决系数的取值范围:[0,1]R2________________________。P46-47:t检验(2.4.5)P49:如何才能缩小置信区间(2个)增大样本容量n。因为在同样的置信水平下,n越大,t分布表中的临界值越小;同时,增大样本容量,还可使样本参数估计量的标准差减小;提高模型的拟合优度。因为样本参数估计量的标准差与残差平方和呈正比,模型拟合优度越高,残差平方和应越小。

相关分析和回归分析的区别与联系(不知道要不要)

联系:都是研究非确定性变量间的统计依赖关系,并能度量线性依赖程度的大小。

区别:从研究目的上看:相关分析是研究变量间相互联系的方向和程度;回归分析是寻求变量间联系的具体数学形式,是要根据自变量的固定值去估计和预测[1][1]因变量的值。

从对变量的处理来看:相关分析中的变量均为随机变量,不考虑两者的因果关系;回归分析是在变量因果关系的基础上研究自变量对因变量的具体影响,必须明确划分自变量和因变量,回归分析中通常假定自变量为非随机变量,因变量为随机变量。

P26-27:随机干扰项:观察值Y围绕它的期望值[2][2]的离差,是一个不可观测的随机变量,又称为随机干扰项或随机误差[3][3]项。

引入随机干扰项的原因

1)代表未知的影响因素;

2)代表残缺数据;

3)代表众多细小影响因素;

4)代表数据观测误差;

5)代表模型设定[4][4]误差;

6)变量的内在随机性。

P26、28:样本回归函数和总体回归函数的公式

总体回归函数:在给定解释变量[5][5]X条件下被解释变量Y的期望轨迹称为总体回归线,或更一般地称为总体回归曲线。相应的函数称为(双变量)总体回归函数(PRF)。

确定形式:

随机形式:

样本回归函数SRF画一条直线以尽好地拟合该散点图,由于样本取自总体,可以该直线近似地代表总体回归线。该直线称为样本回归线(sample regression lines)。样本回归线的函数形式[6][6]称为样本回归函数.

确定形式:

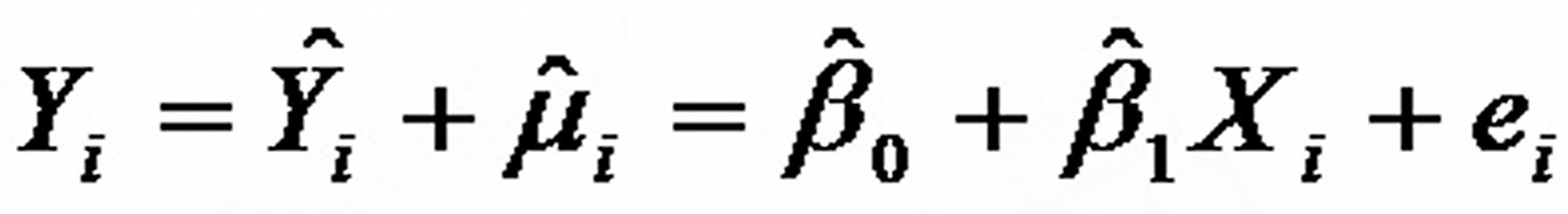

随机形式:

P29:图2.1.3

回归分析的主要目的:根据样本回归函数SRF,估计总体回归函数PRF。这就要求设计一方法构造SRF使其尽可能接近PRF。这里的PRF可能永远无法知道。

P30-32:一元线性回归模型的基本假设

假设1、回归模型是正确的。(选择了正确的变量;选择了正确的函数形式。)

假设2、解释变量X是确定性变量,不是随机变量,在重复抽样中取固定值。

假设3、解释变量X在所抽取的样本中具有变异性,而且随着样本容量的无限增加,解释变量X的方差趋于一个非零的有限常数。

假设3、解释变量X在所抽取的样本中具有变异性,而且随着样本容量的无限增加,解释变量X的方差趋于一个非零的有限常数。

假设4、随机误差项具有给定X条件下的零均值、同方差和不序列相关性:

E(i)=0

Var (i)=2

Cov(i,j)=0i≠j i,j= 1,2, …,n

假设5、随机误差项与解释变量X之间不相关:

Cov(Xi,i)=0 i=1,2, …,n

假设6、随机误差项服从零均值、同方差、零协方差的正态分布

假设6、随机误差项服从零均值、同方差、零协方差的正态分布

注意:

如果假设1、2满足,则假设3也满足;

如果假设4满足,则假设2也满足。

i~N(0,2) i=1,2, …,n

P33:最小二乘法的推导过程(推导至2.3.5)

普通最小二乘法(OLS)给出的判断标准是:二者之差的平方和 最小。

最小。

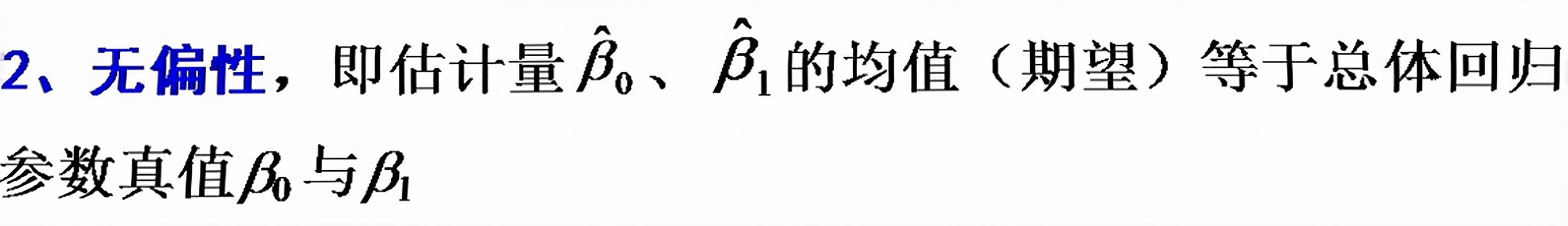

P38-40:最小二乘估计法的性质(重点看前三个,知道线性性和无偏性的推导)

(1)线性性,即它是否是另一随机变量的线性函数;

(2)无偏性,即它的均值或期望值是否等于总体的真实值;

(3)有效性,即它是否在所有线性无偏估计量中具有最小方差。

P44:图2.4.2区别那三个平方和(TSS,ESS,RSS)

TSS=ESS+RSS

Y的观测值围绕其均值的总离差(total variation)可分解为两部分:一部分来自回归线(ESS),另一部分则来自随机势力(RSS)。

总体平方和

回归平方和

残差平方和

P45:可决系数R2统计量

拟合优度检验:对样本回归直线与样本观测值之间拟合程度的检验。

度量拟合优度的指标:判定系数(可决系数)R2

可决系数的取值范围:[0,1]

R2________________________。

P46-47:t检验(2.4.5)

P49:如何才能缩小置信区间(2个)

增大样本容量n。因为在同样的置信水平下,n越大,t分布表中的临界值越小;同时,增大样本容量,还可使样本参数估计量的标准差减小;

提高模型的拟合优度。因为样本参数估计量的标准差与残差平方和呈正比,模型拟合优度越高,残差平方和应越小。

题目解答

答案

越接近 1 ,说明实际观测点离样本线越近,拟合优度[7][7]越高

解析

相关分析与回归分析是统计学中研究变量间关系的两种重要方法。

- 联系:两者均用于分析非确定性变量间的统计依赖关系,且能度量线性依赖程度(如相关系数)。

- 区别:

- 研究目的:相关分析侧重变量间关系的方向和强度;回归分析则通过数学模型定量描述变量间关系,用于预测。

- 变量处理:相关分析中变量均为随机变量,不区分因果;回归分析需明确自变量与因变量,通常假设自变量为非随机。

可决系数($R^2$)是衡量回归模型拟合优度的指标,其取值范围为$[0,1]$。$R^2$越接近1,说明模型对数据的拟合效果越好,实际观测值与回归线的拟合值越接近。

相关分析与回归分析的区别与联系

-

联系:

- 均研究变量间的统计依赖关系。

- 可通过相关系数(如皮尔逊相关系数)或回归系数量化依赖程度。

-

区别:

- 研究目的:

- 相关分析:判断变量间是否相关,以及相关程度(如正/负相关)。

- 回归分析:建立变量间数学模型,用于预测因变量。

- 变量性质:

- 相关分析:变量均为随机变量,无因果关系假设。

- 回归分析:需明确自变量(非随机)与因变量(随机),强调因果关系。

- 研究目的:

可决系数($R^2$)的意义

- 定义:$R^2 = \frac{\text{回归平方和(ESS)}}{\text{总平方和(TSS)}} = 1 - \frac{\text{残差平方和(RSS)}}{\text{TSS}}$。

- 作用:

- 度量回归模型对被解释变量变异性解释的比例。

- $R^2$越接近1,说明回归线对观测值的拟合效果越好,实际数据点越集中于回归线附近。